Przetwarzamy nieskończone ilości danych, ale brakuje nam mądrości.

ArtykułyHobbit Bilbo, kot Garfield i inni leniwi bohaterowie – czyli czas na relaks

ArtykułyHobbit Bilbo, kot Garfield i inni leniwi bohaterowie – czyli czas na relaks Marcin Waincetel15

Marcin Waincetel15 ArtykułyCzytasz książki? To na pewno…, czyli najgorsze stereotypy o czytelnikach i czytaniu

ArtykułyCzytasz książki? To na pewno…, czyli najgorsze stereotypy o czytelnikach i czytaniu Ewa Cieślik252

Ewa Cieślik252 ArtykułyPodróże, sekrety i refleksje – książki idealne na relaks, czyli majówka z literaturą

ArtykułyPodróże, sekrety i refleksje – książki idealne na relaks, czyli majówka z literaturą Marcin Waincetel11

Marcin Waincetel11 ArtykułyPisarze patronami nazw ulic. Polscy pisarze i poeci na początek

ArtykułyPisarze patronami nazw ulic. Polscy pisarze i poeci na początek Remigiusz Koziński42

Remigiusz Koziński42

- Polecamy

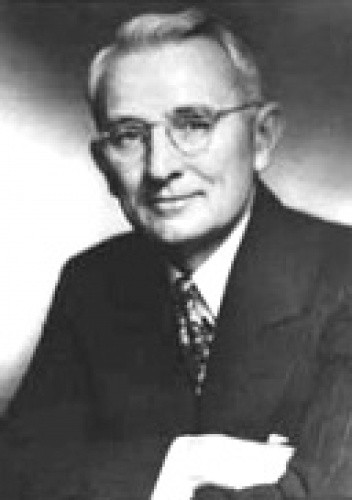

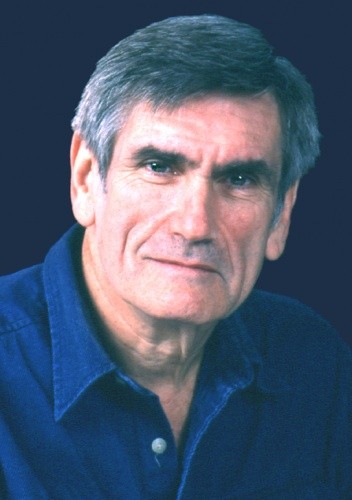

Siva Vaidhyanathan

Źródło: https://mediastudies.virginia.edu/people/sv2r15,5/10Pisze książki: nauki społeczne (psychologia, socjologia, itd.)Urodzony: 1966 (data przybliżona)

Źródło: https://mediastudies.virginia.edu/people/sv2r15,5/10Pisze książki: nauki społeczne (psychologia, socjologia, itd.)Urodzony: 1966 (data przybliżona)Ten autor nie ma jeszcze opisu. Jeżeli chcesz wysłać nam informacje o autorze - napisz na: admin@lubimyczytac.pl

5,5/10średnia ocena książek autora120 przeczytało książki autora174 chce przeczytać książki autoraDyskutuj o autorze0fanów autoraZostań fanem autoraKsiążki i czasopisma

- Wszystkie

- Książki

- Czasopisma

Antisocial Media. Jak Facebook oddala nas od siebie i zagraża demokracji.Siva Vaidhyanathan5,5 z 106 ocen297 czytelników 25 opinii2018Popularne cytaty autora

Zobacz więcej cytatówCytat dniaJuż w młodości zdajemy sobie sprawę, że nasze życie społeczne składa się z przecinających się kręgów rodzinnych, przyjaciół, znajomych i lud...

Już w młodości zdajemy sobie sprawę, że nasze życie społeczne składa się z przecinających się kręgów rodzinnych, przyjaciół, znajomych i ludzi oraz instytucji, którzy sprawują nad nami władzę. Tak więc jako dzieci szybko uczymy się, jak zarządzać swoimi reputacjami w obrębie tych kontekstów. Uczymy się, często na własnych błędach, że niektóre rzeczy można powiedzieć przyjaciołom, ale nie rodzicom. (...) Tak więc zarządzamy wiedzą o nas samych. (...) Ten proces zarządzania reputacją w różnych kontekstach jest właśnie tym, co zazwyczaj nazywamy prywatnością. Facebook miesza nasze społeczne konteksty. (...) Podkreślając "kontrolę ze strony użytkownika" Facebook składa na nasze ramiona ciężar zarządzania upadkiem kontekstów społecznych, które sam wywołuje.

osób to lubi(...) pomylił komunikację z dyskusją. Media społecznościowe, a już zwłaszcza Facebook, nie sprzyjają dyskusji. Sprzyjają wygłaszaniu deklara...

(...) pomylił komunikację z dyskusją. Media społecznościowe, a już zwłaszcza Facebook, nie sprzyjają dyskusji. Sprzyjają wygłaszaniu deklaracji. Nie umożliwiają głębokich deliberacji. Inspirują powierzchowne reakcje.

osób to lubi

Najnowsze opinie o książkach autora

Antisocial Media. Jak Facebook oddala nas od siebie i zagraża demokracji. Siva Vaidhyanathan5,5 Ciężko się czyta, często nudzi. Autor się powtarza w wielu miejscach w książce i mam wrażenie, że większość zawartości tej książki opisuje związek między facebookiem a wyborami prezydenckimi w USA, które wygrał Trump. Jednocześnie, można się z książki dowiedzieć wielu ciekawych rzeczy, co nie zmienia faktu, że po kilkdziesięciu stronach czytałam już na siłę.Antisocial Media. Jak Facebook oddala nas od siebie i zagraża demokracji. Siva Vaidhyanathan5,5

Ciężko się czyta, często nudzi. Autor się powtarza w wielu miejscach w książce i mam wrażenie, że większość zawartości tej książki opisuje związek między facebookiem a wyborami prezydenckimi w USA, które wygrał Trump. Jednocześnie, można się z książki dowiedzieć wielu ciekawych rzeczy, co nie zmienia faktu, że po kilkdziesięciu stronach czytałam już na siłę.Antisocial Media. Jak Facebook oddala nas od siebie i zagraża demokracji. Siva Vaidhyanathan5,5 Machina przyjemności i dezinformacji Wbrew zapewnieniom Zuckerberga, że Facebook wspiera procesy demokratyczne i dba o wiarygodność rozpowszechnianych informacji, wszyscy, którzy śledzą wzrost autorytaryzmu na całym świecie, uznaliby Indie, Indonezję, Kenię, Polskę, Węgry, Turcję, oraz Stany Zjednoczone za miejsca, w których Facebook bezpośrednio przyczynił się do wzrostu przemocy na tle etnicznym i nacjonalizmu religijnego, a także wzrostu popularności autorytarnych przywódców. Ponadto Facebook, mimo wzmożonej pracy wielu moderatorów i administratorów, zalał także świat kakofonią zmyślonych informacji – tzw. fake newsów. W ten właśnie sposób serwis z niewinnej platformy społecznościowej stworzonej przez studentów Harvardu przekształcił się w siłę, która -uprzyjemniając życie jednostkom - stawia poważne wyzwanie demokracji. Kultura Doliny Krzemowej oparta jest na powszechnym tam przywiązaniu do logicznego myślenia oraz podejmowania decyzji na podstawie danych. Jest wyraźnie kosmopolityczna i tolerancyjna wobec wszelkiej odmienności i odrębności. Jak w takim razie ta oświecona firma przyczyniła się do wzrostu popularności nacjonalistów pokroju Donalda Trumpa, Marine Le Pen i Państwa Islamskiego oraz spopularyzowania idei niezgodnych z nauką, jak chociażby ruch antyszczepionkowy? Wpływ na to miała bezsprzecznie ogromna popularność tego medium społecznościowego w naszym życiu. Ta popularność właśnie niesie ze sobą ogromne ryzyko, nad którym nie udało się zapanować Zuckerbergowi. Widzimy to ciągle w zalewie fake newsów, stanowiących zresztą tylko jeden z rodzajów „zanieczyszczenia” informacyjnego. Rodzaje treści, jakie pojawiają się w Facebookowym News Feedzie (sposób prezentacji treści użytkownikowi),często wizualnie nie dają się od siebie odróżnić, zwłaszcza gdy przeglądamy je na małym ekranie – w telefonie. Wszystkie posty, od filmów z YouTube’a, poprzez artykuły z Gazety Wyborczej, czy Newsweeka, po reklamy ze sklepów internetowych mają taką samą ramkę, czcionkę i format. Nie są więc w stanie wychwycić różnicy pomiędzy opinią wyrażoną na jednym z blogów reklamowanych prywatną stroną na Facebooku, a poważnym artykułem dziennikarza śledczego z pierwszych stron gazet. Po ostatnich wyborach w USA eksperci i analitycy stwierdzili, że obrazy i teksty zawierające absurdalne kłamstwa na temat głównych kandydatów z wielką łatwością zyskiwały popularność na Fb. Głównie z tego powodu, że serwis nie podsuwał żadnych wskazówek, które mogłyby pomóc zidentyfikować i ocenić odbiorcom źródło informacji. Nic więc dziwnego, że za pomocą mediów społecznościowych upada rzetelne dziennikarstwo i nieważne stają się opinie ekspertów, ginące w zalewie nieprawdziwych informacji. Drugi strukturalny problem polega na tym, że Fb propaguje głównie treści, które mocno działają na emocje. Toteż w serwisie szybko zyskują popularność słodkie kotki, niemowlęta, pełne mądrości „skrzydlate słowa”, quizy dotyczące stylu życia oraz mowa nienawiści. Został on wprost zaprojektowany tak, by promować to wszystko, co wywołuje skrajne emocje. Zbyt łatwo jest zanieczyścić serwis bzdurami, by odwrócić uwagę lub propagandą, by zmobilizować masy. Serwis mierzy poziom zaangażowania liczbą kliknięć, polubień, udostępnień lub komentarzy. To sprawia, że najbardziej zapalne materiały rozprzestrzeniają się najszybciej. Trzeźwe, wyważone opinie nie mają szans na Fb. A gdy serwis zapanuje nad naszą wizją świata oraz rządzi naszymi kręgami społecznymi, wszyscy stajemy się potencjalnymi przekaźnikami ekstremistycznych bzdur. Trzecim zjawiskiem jest tzw. „bańka filtrująca” – pojęcie ukute przez Eliego Parisera, opisujące sposoby, jakie Facebook i Google stosują, by podsuwać użytkownikom więcej tego, co im się podoba, zawężając tym samym ich pole widzenia i tworząc „komory pogłosowe” potwierdzające ich przekonania. Chodzi o to, że jeśli zazwyczaj dajesz lajki i zostawiasz serduszka na określonych stronach, profilach lub pod linkami do pewnych stron internetowych, jeśli udostępniasz je na swoim profilu, Facebook wie, że jesteś w nie wysoce zaangażowany. Więc podsuwa Ci więcej takich treści, a mniej tych, które nie przyciągają twoich interakcji. Wybiera je za pomocą prognozowanej oceny każdego elementu, niezależnie od tego, czy udostępnił je ktoś z twoich znajomych, czy jest to zakupiona reklama. Wkrótce perspektywy twojego News Feedu zawężają się coraz bardziej ze względu na to, że twoi znajomi i lubiane przez ciebie treści publikują raczej spójne politycznie treści. Toteż z mniejszym prawdopodobieństwem natrafimy na coś z zewnątrz, a więc pozostaniemy nieświadomi, że istnieją kontrargumenty i konkurencyjne roszczenia. Dotyczy to każdej grupy społecznej, która dzięki mediom społecznościowym zamyka się w swojej bańce informacyjnej. Od ekologów po nacjonalistów. Od rasistów po ortodoksów religijnych. Jeśli więc ktoś chciałby stworzyć maszynę, kierującą propagandę do milionów ludzi, odciągającą ich od ważnych spraw, nakręcającą nienawiść i fanatyzm, rujnującą zaufanie społeczne, niszczącą dziennikarstwo i rozpowszechniającą wątpliwości dotyczące nauki oraz inwigilującą nas wszystkich, pewnie byłoby to coś bardzo podobnego do Facebooka. Zatem przed wysłaniem w świat kolejnego lajka – musimy się po prostu zatrzymać i pomyśleć. Tekst powstał na podstawie książki: „Antisocial media. Jak Facebook oddala nas od siebie i zagraża demokracji” Sivy Vaidhyanathana (przeł. Weronika Mincer i Katarzyna Sosnowska),Grupa Wydawnicza Foksal, Warszawa 2018

Machina przyjemności i dezinformacji Wbrew zapewnieniom Zuckerberga, że Facebook wspiera procesy demokratyczne i dba o wiarygodność rozpowszechnianych informacji, wszyscy, którzy śledzą wzrost autorytaryzmu na całym świecie, uznaliby Indie, Indonezję, Kenię, Polskę, Węgry, Turcję, oraz Stany Zjednoczone za miejsca, w których Facebook bezpośrednio przyczynił się do wzrostu przemocy na tle etnicznym i nacjonalizmu religijnego, a także wzrostu popularności autorytarnych przywódców. Ponadto Facebook, mimo wzmożonej pracy wielu moderatorów i administratorów, zalał także świat kakofonią zmyślonych informacji – tzw. fake newsów. W ten właśnie sposób serwis z niewinnej platformy społecznościowej stworzonej przez studentów Harvardu przekształcił się w siłę, która -uprzyjemniając życie jednostkom - stawia poważne wyzwanie demokracji. Kultura Doliny Krzemowej oparta jest na powszechnym tam przywiązaniu do logicznego myślenia oraz podejmowania decyzji na podstawie danych. Jest wyraźnie kosmopolityczna i tolerancyjna wobec wszelkiej odmienności i odrębności. Jak w takim razie ta oświecona firma przyczyniła się do wzrostu popularności nacjonalistów pokroju Donalda Trumpa, Marine Le Pen i Państwa Islamskiego oraz spopularyzowania idei niezgodnych z nauką, jak chociażby ruch antyszczepionkowy? Wpływ na to miała bezsprzecznie ogromna popularność tego medium społecznościowego w naszym życiu. Ta popularność właśnie niesie ze sobą ogromne ryzyko, nad którym nie udało się zapanować Zuckerbergowi. Widzimy to ciągle w zalewie fake newsów, stanowiących zresztą tylko jeden z rodzajów „zanieczyszczenia” informacyjnego. Rodzaje treści, jakie pojawiają się w Facebookowym News Feedzie (sposób prezentacji treści użytkownikowi),często wizualnie nie dają się od siebie odróżnić, zwłaszcza gdy przeglądamy je na małym ekranie – w telefonie. Wszystkie posty, od filmów z YouTube’a, poprzez artykuły z Gazety Wyborczej, czy Newsweeka, po reklamy ze sklepów internetowych mają taką samą ramkę, czcionkę i format. Nie są więc w stanie wychwycić różnicy pomiędzy opinią wyrażoną na jednym z blogów reklamowanych prywatną stroną na Facebooku, a poważnym artykułem dziennikarza śledczego z pierwszych stron gazet. Po ostatnich wyborach w USA eksperci i analitycy stwierdzili, że obrazy i teksty zawierające absurdalne kłamstwa na temat głównych kandydatów z wielką łatwością zyskiwały popularność na Fb. Głównie z tego powodu, że serwis nie podsuwał żadnych wskazówek, które mogłyby pomóc zidentyfikować i ocenić odbiorcom źródło informacji. Nic więc dziwnego, że za pomocą mediów społecznościowych upada rzetelne dziennikarstwo i nieważne stają się opinie ekspertów, ginące w zalewie nieprawdziwych informacji. Drugi strukturalny problem polega na tym, że Fb propaguje głównie treści, które mocno działają na emocje. Toteż w serwisie szybko zyskują popularność słodkie kotki, niemowlęta, pełne mądrości „skrzydlate słowa”, quizy dotyczące stylu życia oraz mowa nienawiści. Został on wprost zaprojektowany tak, by promować to wszystko, co wywołuje skrajne emocje. Zbyt łatwo jest zanieczyścić serwis bzdurami, by odwrócić uwagę lub propagandą, by zmobilizować masy. Serwis mierzy poziom zaangażowania liczbą kliknięć, polubień, udostępnień lub komentarzy. To sprawia, że najbardziej zapalne materiały rozprzestrzeniają się najszybciej. Trzeźwe, wyważone opinie nie mają szans na Fb. A gdy serwis zapanuje nad naszą wizją świata oraz rządzi naszymi kręgami społecznymi, wszyscy stajemy się potencjalnymi przekaźnikami ekstremistycznych bzdur. Trzecim zjawiskiem jest tzw. „bańka filtrująca” – pojęcie ukute przez Eliego Parisera, opisujące sposoby, jakie Facebook i Google stosują, by podsuwać użytkownikom więcej tego, co im się podoba, zawężając tym samym ich pole widzenia i tworząc „komory pogłosowe” potwierdzające ich przekonania. Chodzi o to, że jeśli zazwyczaj dajesz lajki i zostawiasz serduszka na określonych stronach, profilach lub pod linkami do pewnych stron internetowych, jeśli udostępniasz je na swoim profilu, Facebook wie, że jesteś w nie wysoce zaangażowany. Więc podsuwa Ci więcej takich treści, a mniej tych, które nie przyciągają twoich interakcji. Wybiera je za pomocą prognozowanej oceny każdego elementu, niezależnie od tego, czy udostępnił je ktoś z twoich znajomych, czy jest to zakupiona reklama. Wkrótce perspektywy twojego News Feedu zawężają się coraz bardziej ze względu na to, że twoi znajomi i lubiane przez ciebie treści publikują raczej spójne politycznie treści. Toteż z mniejszym prawdopodobieństwem natrafimy na coś z zewnątrz, a więc pozostaniemy nieświadomi, że istnieją kontrargumenty i konkurencyjne roszczenia. Dotyczy to każdej grupy społecznej, która dzięki mediom społecznościowym zamyka się w swojej bańce informacyjnej. Od ekologów po nacjonalistów. Od rasistów po ortodoksów religijnych. Jeśli więc ktoś chciałby stworzyć maszynę, kierującą propagandę do milionów ludzi, odciągającą ich od ważnych spraw, nakręcającą nienawiść i fanatyzm, rujnującą zaufanie społeczne, niszczącą dziennikarstwo i rozpowszechniającą wątpliwości dotyczące nauki oraz inwigilującą nas wszystkich, pewnie byłoby to coś bardzo podobnego do Facebooka. Zatem przed wysłaniem w świat kolejnego lajka – musimy się po prostu zatrzymać i pomyśleć. Tekst powstał na podstawie książki: „Antisocial media. Jak Facebook oddala nas od siebie i zagraża demokracji” Sivy Vaidhyanathana (przeł. Weronika Mincer i Katarzyna Sosnowska),Grupa Wydawnicza Foksal, Warszawa 2018Autorzy piszący podobnie

Popularne w kategorii książek autora

Popularni autorzy